2012-02-01 [Mac][Arduino]Getting Started

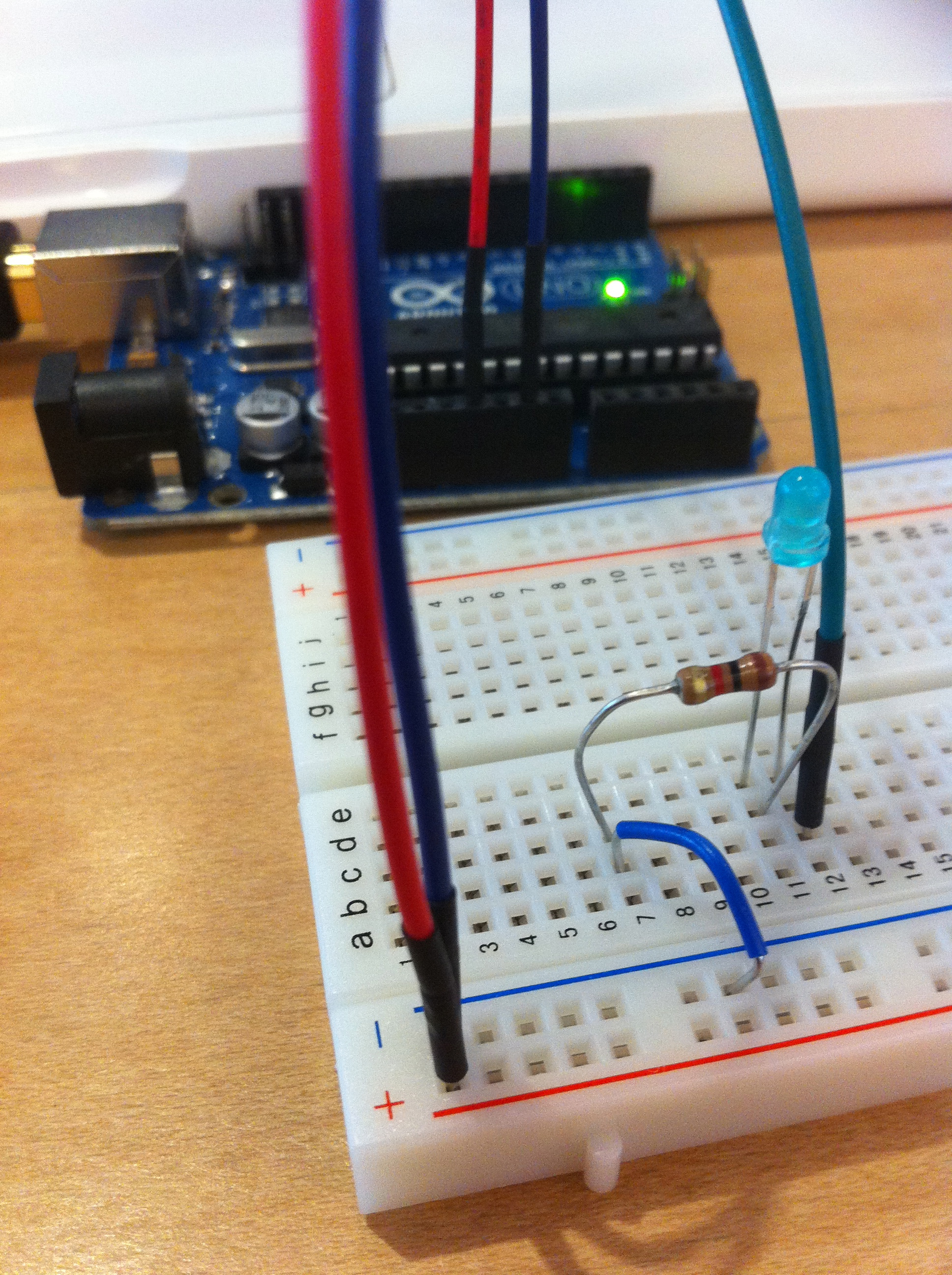

今回は、Arduinoだ。

まずは、Arduinoを入手しないと話にならない。私はスイッチサイエンスの製品をAmazonで購入した。

ArduinoとMacとは、USBケーブルで接続となるとなるがA-Bタイプを購入する事。A-miniBは別物だ!私はそれで失敗した。

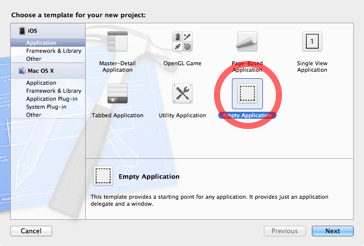

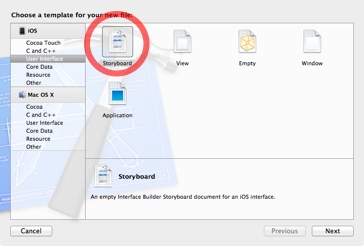

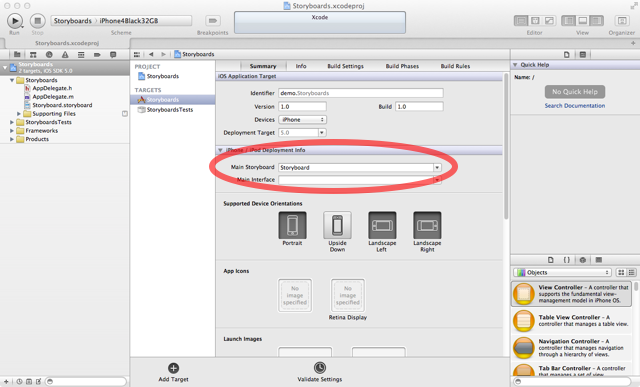

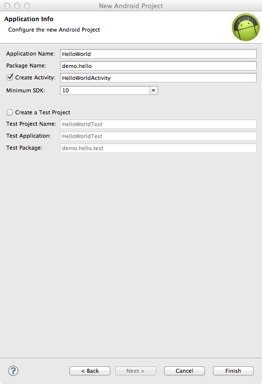

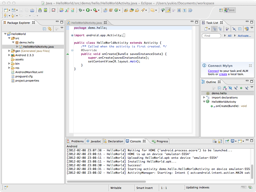

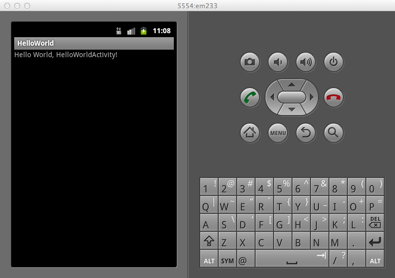

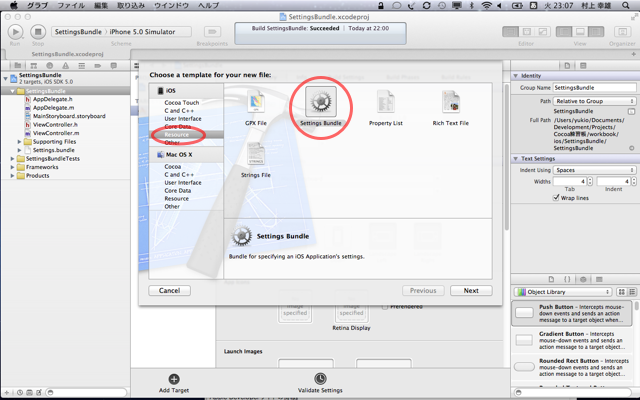

製品が入手できたら以下のサイトの説明通りにすればいい。

ただ、私の場合だけの可能性があるが、入手したArduino UNO R3は、初期状態でExamples/1.Basics/Blinkがアップロードされている様で、この手順で試しても最初は変化が分からなかった。

_ m_yukio [環境構築失敗の原因が分かった。 後で試す。]